Intuitiv, aber nicht trivial – Was Unternehmen beim Einsatz generativer KI übersehen

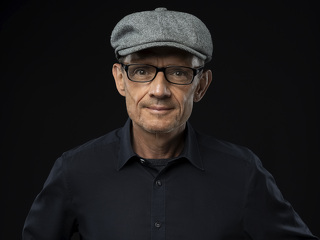

Was aussieht wie Magie, ist in Wahrheit ein Systemrisiko: Warum Unternehmen bei ChatGPT & Co. dringend mehr Kontrolle als Komfort brauchen, erklärt Diplom-Mathematiker Dirk Pappelbaum (Inveda.net) im Gastbeitrag.

Die scheinbare Einfachheit in der Anwendung, wie bei ChatGPT, Claude und Gemini trifft auf hohe technische Komplexität und regulatorische Anforderungen, sobald Unternehmen diese Technologien professionell, sicher und skalierbar nutzen wollen. Was im Alltag als benutzerfreundliches Textfeld erscheint, entpuppt sich im betrieblichen Maßstab als tiefgreifende Infrastrukturfrage. Die aktuelle Phase generativer KI ist geprägt von einem Paradox: Intuitive Nutzung an der Oberfläche – organisatorische und rechtliche Komplexität in der Tiefe. Was leicht aussieht, verlangt in Wahrheit hochgradige Steuerungsmechanismen, technische Einbettung und rechtlich belastbare Rahmenbedingungen.

Komfort contra Kontrolle

Generative KI ist auf dem Weg, sich quer durch Büroanwendungen und Fachprozesse einzuschreiben – sei es in PowerPoint, E-Mail, Vertragsmanagement oder Berichtserstellung. Der Zugang ist niedrigschwellig, teils direkt in die gängigen Tools integriert. Doch diese Leichtigkeit täuscht. Denn unternehmenskritische Informationen, Prozesse und Verantwortlichkeiten lassen sich nicht über ein Prompt steuern.

Für den sicheren, rechtskonformen Einsatz bedarf es:

- eingebetteter Modellarchitekturen (embedded systems),

- transparenter Governance-Strukturen,

- technischer Auditierbarkeit und Zugriffskontrolle,

- klarer Rollenteilung und Prozessverantwortung.

Die eigentliche Herausforderung liegt nicht im Prompt – sondern im Prozess, der ihn umgibt.

Wie auch eine aktuelle Studie von KPMG zeigt, erkennen zwar 91 Prozent der Unternehmen die strategische Bedeutung generativer KI, aber nur 26 Prozent verfügen über eine unternehmensweite Trusted-AI-Strategie. Es klafft eine Lücke zwischen Nutzung und Steuerungsfähigkeit.

KPMG (2025): Generative KI in der deutschen Wirtschaft. Gesamtreport, abrufbar unter: kpmg.de

Diese Diskrepanz zeigt sich besonders deutlich in stark regulierten Branchen wie der Finanzwirtschaft, dem Versicherungswesen oder im Gesundheitssektor: Wo Compliance und Revisionssicherheit gelten, reichen intuitive Interfaces nicht aus – dort braucht es Infrastruktur, Nachvollziehbarkeit und Kontrolle.

Demokratisierungstechnologie mit Systemrisiko

Der Erfolg generativer Systeme liegt auch in ihrer demokratischen Zugänglichkeit: Jede Mitarbeiterin, jeder Schüler, jede Kundin kann einen Prompt absetzen. Aber genau hier entsteht ein neues Risiko: Die Tools suggerieren Beherrschbarkeit – auch dort, wo sie inhaltlich, technisch oder rechtlich nicht mehr kontrolliert werden.

Große Sprachmodelle (LLMs) sind nicht nur technisch hochkomplex, sondern auch epistemisch opak: Ihre Antworten lassen sich nicht vollständig nachvollziehen, sind nicht deterministisch und nicht überprüfbar im klassischen Sinne. Wer diese Systeme ohne Governance einsetzt, verlagert Entscheidungsmacht in den semantischen Nebel.

Zudem wächst die Gefahr sogenannter „Schatten-KI“ – also Anwendungen, die ohne Kenntnis der IT oder Compliance-Abteilung verwendet werden. Gerade in Konzernen mit Tausenden Beschäftigten und unterschiedlich ausgeprägter Digitalkompetenz ist das eine reale Gefahr.

Begriffsverwirrung als strukturelle Schwäche

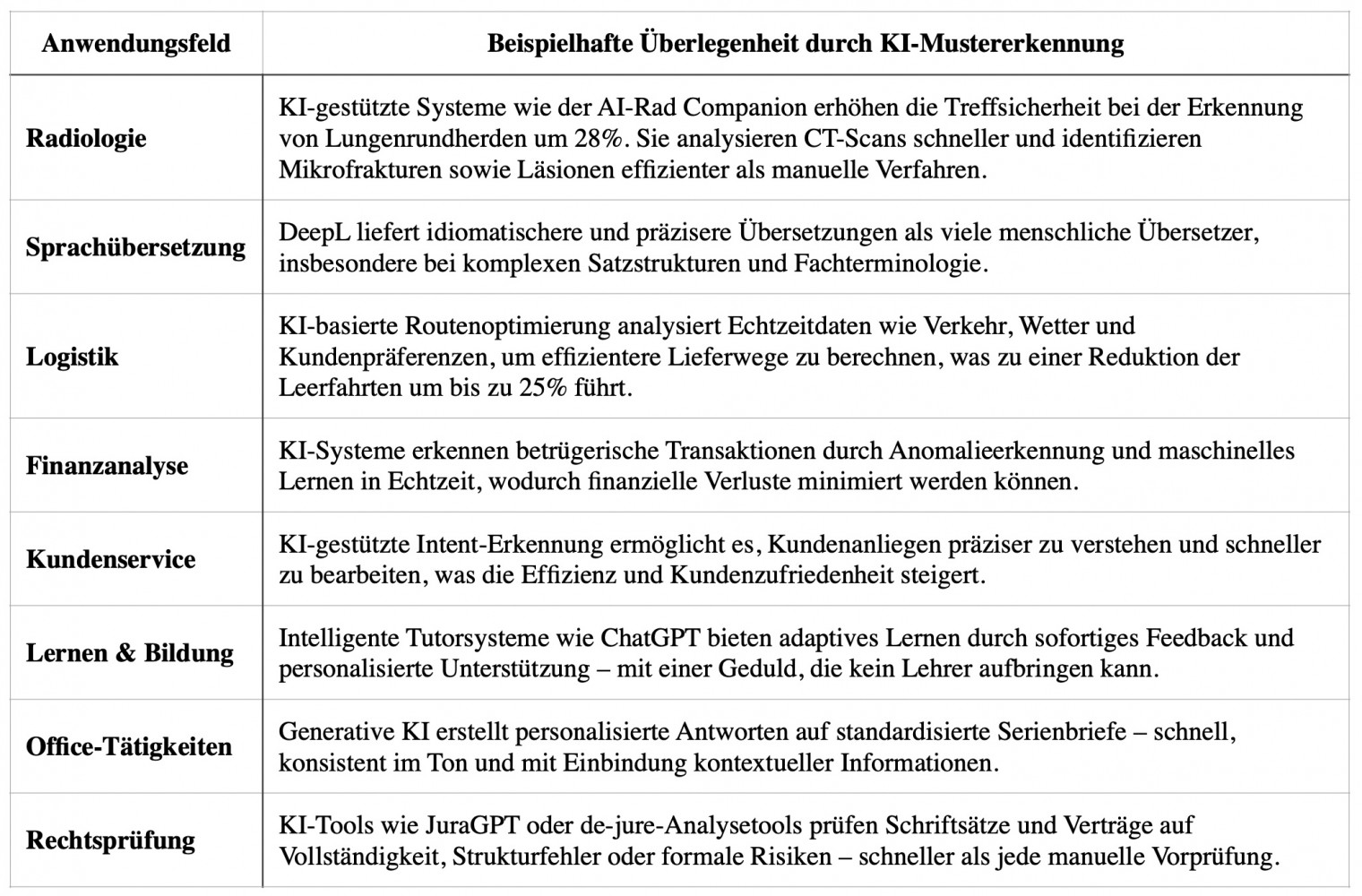

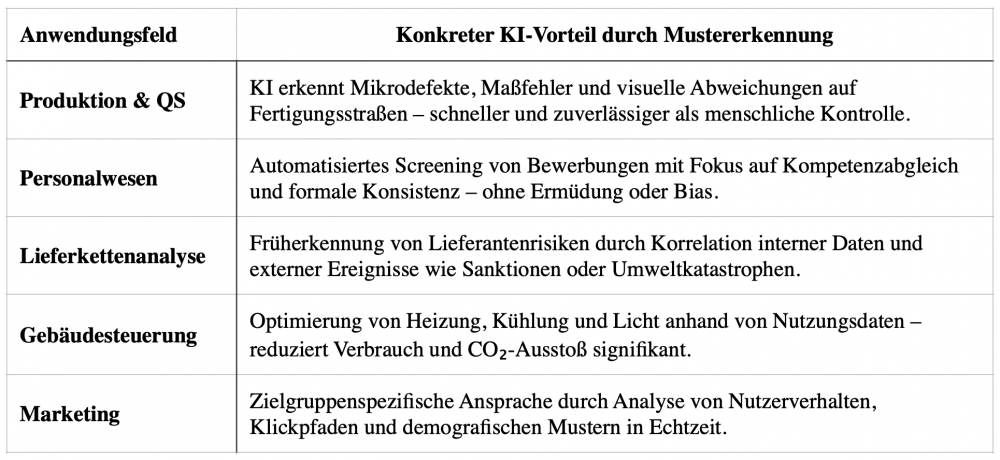

Ein zentrales Problem liegt in der unscharfen Verwendung des Begriffs „Künstliche Intelligenz“. Was heute unter diesem Etikett firmiert, sind in vielen Fällen statistische Mustererkennungssysteme. Sprachmodelle wie GPT oder Claude generieren keine Erkenntnis – sie produzieren wahrscheinlichkeitstreue Fortsetzungen linguistischer Muster.

Diese Tatsache wird im Diskurs häufig übersehen – mit konkreten Folgen:

- Verstehen wird suggeriert, wo nur Antizipation stattfindet,

- Entscheidungsprozesse werden delegiert, ohne Verantwortlichkeit klar zu fassen,

- Technologische Euphorie ersetzt strukturelle Ernsthaftigkeit.

Wer Mustererkennung für Intelligenz hält, verfehlt den architektonischen Kern dieser Systeme – und riskiert operative Fehleinschätzungen.

Mündigkeit statt Magie

Generative KI kann Effizienz und Innovation ermöglichen – aber nur dort, wo sie technisch sicher, datenschutzkonform und organisatorisch verankert betrieben wird. Die aktuelle Verbreitung in Office-Umgebungen darf nicht über die Anforderungen hinwegtäuschen.

Dies gilt besonders für Systeme, die in Kommunikationsprozesse eingreifen: Wer etwa mit KI auf Beschwerden oder Presseanfragen antwortet, delegiert Verantwortung – mit potenziell gravierenden Folgen. Prompt-Sicherheit, semantische Konsistenz und ethische Standards müssen Teil jeder KI-Strategie sein.

Nutzerfreundlichkeit ist nicht gleich Unternehmensreife. Unternehmen, die heute Präzision über Oberfläche stellen, legen den Grundstein für Souveränität.

Nachsatz: Zwischen Exaktheit und Menschlichkeit

Als Mathematiker ist mir der Anspruch an Präzision vertraut: klare Fragen, nachvollziehbare Beweise, überprüfbare Resultate. Doch ich weiß auch, dass nicht jeder Bereich unseres Lebens dieser Logik folgt. Sprache, Empathie, Verantwortung, Bildung – sie entziehen sich der Exaktheit und sind gerade deshalb wesentlich.

Und doch zeigt sich: In bestimmten Feldern ist die Maschine dem Menschen mittlerweile überlegen – weil sie Muster erkennt, wo unser Blick begrenzt bleibt. Diese Leistungen verdienen Anerkennung – und intelligente Integration.

- In der Radiologie erkennt KI Mikroanomalien in CT-Bildern.

- In der Rechtsprüfung analysieren Systeme wie JuraGPT Schriftsätze schneller als jede Kanzleikraft.

- In der Bildung antworten Tutorsysteme geduldig – so geduldig, wie es kein Lehrer durchhalten kann.

Die Zukunft der KI ist nicht algorythmisch – sie ist dialogisch. Sie entsteht dort, wo Mensch und Modell sich nicht verwechseln, sondern ergänzen.

Themen:

LESEN SIE AUCH

KI in der Versicherungswirtschaft: DAV sieht Aktuare in Schlüsselrolle

„Unsere KI ersetzt keine Vermittler – sie verschafft ihnen Zeit für das, was wirklich zählt“

KI ist Alltag: Mehrheit der Deutschen nutzt Künstliche Intelligenz bereits regelmäßig

Digitale Sichtbarkeit neu gedacht – ERGO und ECODYNAMICS analysieren LLM-Suchverhalten

Unsere Themen im Überblick

Themenwelt

Wirtschaft

Management

Recht

Finanzen

Assekuranz

Leistung neu denken: Warum mentale Stärke für Entscheider zum Erfolgsfaktor wird

Der Dollar ist tot, es lebe der Dollar

Wer zahlt im Ernstfall? Die Versicherungslücke internationaler Remote Work

Wenn Nutzen zählt, wird es für die Politik unbequem

Die neue Ausgabe kostenlos im Kiosk

Werfen Sie einen Blick in die aktuelle Ausgabe und überzeugen Sie sich selbst vom ExpertenReport. Spannende Titelstories, fundierte Analysen und hochwertige Gestaltung – unser Magazin gibt es auch digital im Kiosk.