Meta scannt Europa: Wie unsere Posts zur Futterquelle für künstliche Intelligenz werden

Meta, der Mutterkonzern hinter Facebook, Instagram und WhatsApp, bereitet sich aktuell darauf vor, seine KI-Modelle mit Daten europäischer Nutzer zu trainieren. Im Fokus stehen dabei öffentliche Beiträge, Kommentare und Chatverläufe mit Meta AI – also der hauseigenen Künstlichen Intelligenz, die seit März 2025 in Europa verfügbar ist. Private Nachrichten mit Freunden und Familie sollen laut Meta von diesem Training ausgenommen bleiben. Auch Inhalte von Nutzern unter 18 Jahren sind explizit ausgeschlossen.

Was auf den ersten Blick nach einer technischen Notwendigkeit klingt, offenbart bei näherem Hinsehen tiefgreifende Auswirkungen auf den europäischen Datenschutz und die digitale Selbstbestimmung.

Hintergrund: Zögerlicher Start nach regulatorischem Gegenwind

Noch im vergangenen Jahr hatte Meta seine KI-Trainingspläne für Europa auf Eis gelegt. Die irische Datenschutzbehörde (DPC), zuständig für Metas europäische Aktivitäten, hatte das Unternehmen dazu aufgefordert, bis zur Klärung der Rechtslage abzuwarten. Erst eine Entscheidung des Europäischen Datenschutzausschusses (EDSA) vom Dezember 2024 brachte eine neue Dynamik in die Diskussion. Meta interpretiert diese nun so, dass die Nutzung öffentlicher Inhalte rechtlich zulässig sei – sofern Nutzer informiert und über Widerspruchsmöglichkeiten aufgeklärt werden.

Was genau verwendet wird – und was nicht

Laut aktuellem Stand werden folgende Datenarten für das Training von Meta AI herangezogen:

-

Öffentliche Beiträge und Kommentare auf Facebook und Instagram

-

Chatverläufe mit Meta AI, sofern über die neue Schaltfläche mit dem bunten Ring in den Apps kommuniziert wurde

-

Ausschluss: Private Nachrichten mit Kontakten, etwa in Messenger oder WhatsApp

-

Ausschluss: Inhalte von Minderjährigen

Diese Differenzierung markiert zwar einen Fortschritt gegenüber der pauschalen Datennutzung, entbindet Meta jedoch nicht von der Pflicht zur detaillierten Aufklärung.

Transparenz und Widerspruchsrecht

Noch diese Woche will Meta beginnen, seine EU-Nutzer über In-App-Benachrichtigungen und E-Mails über die neue Datenverarbeitung zu informieren. Die Mitteilungen enthalten Links zu Widerspruchsformularen, mit denen Nutzer die Nutzung ihrer Inhalte für das KI-Training untersagen können. Auch die überarbeitete Datenschutzerklärung von Meta soll diese Option enthalten.

Interessanterweise weist Meta dort gleichzeitig darauf hin, dass „basierend auf Rückmeldungen von Aufsichtsbehörden“ die Trainingspläne mit EU-Daten noch immer verzögert seien. Die Kommunikation des Konzerns bleibt also ambivalent – einerseits proaktiv, andererseits defensiv.

Technologische Relevanz – und ethische Grauzonen

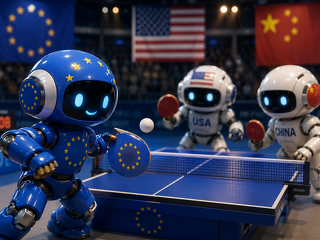

Aus technischer Sicht ist klar: Um konkurrenzfähig zu bleiben, braucht Meta große Mengen an lokalisierten, sprachlich differenzierten Trainingsdaten. Öffentliche Beiträge bieten ein nahezu unerschöpfliches Reservoir an Alltagskommunikation – ein idealer Nährboden für generative KI. Doch was technisch logisch erscheint, stellt juristisch und ethisch eine Gratwanderung dar.

Insbesondere die Tatsache, dass Nutzer standardmäßig Teil des Trainingspools werden, solange sie nicht aktiv widersprechen, birgt erhebliches Konfliktpotenzial mit dem europäischen Datenschutzverständnis, das eigentlich auf dem Prinzip der informierten Einwilligung fußt.

Ein Weckruf für europäische Nutzer

Was hier geschieht, ist mehr als eine technische Implementierung – es ist ein kultureller Wendepunkt. Unsere öffentlichen Äußerungen werden zur Währung im KI-Zeitalter. Während Meta betont, dass alles gesetzeskonform sei, sehen Kritiker wie die NGO NOYB ein gefährliches Spiel mit der Datenhoheit der Nutzer.

In der Praxis bedeutet dies: Wer auch nur einen öffentlichen Kommentar auf Facebook oder Instagram absetzt, sollte sich bewusst sein, dass dieser Teil eines globalen Trainingsprozesses werden kann. Die Möglichkeit zum Widerspruch ist da – aber sie muss aktiv genutzt werden.

Themen:

LESEN SIE AUCH

Datenschutzstrafen für Unternehmen auf Rekordhöhe

Call-Recording und KI: Wo rechtliche Risiken beginnen

Von der Anfrage bis zur Abrechnung: All-in-One Lösungen für Vermietungsunternehmen

Wie ein Dokumentenmanagement-System zu mehr Erfolg verhelfen kann

Unsere Themen im Überblick

Themenwelt

Wirtschaft

Management

Recht

Finanzen

Assekuranz

Europas KI-Problem beginnt beim falschen Architekturverständnis

Altersvorsorgereform 2027: Wer die Komplexität beherrscht, gewinnt den Markt

Anthropic KI Claude Mythos und das Ende kontrollierter Verfügbarkeit

Schadenmanagement: „KI macht unsere Teams wirksamer“

Die neue Ausgabe kostenlos im Kiosk

Werfen Sie einen Blick in die aktuelle Ausgabe und überzeugen Sie sich selbst vom ExpertenReport. Spannende Titelstories, fundierte Analysen und hochwertige Gestaltung – unser Magazin gibt es auch digital im Kiosk.